Die Zahl, die niemand zeigt

Bitten Sie ChatGPT um eine CRM-Empfehlung. Notieren Sie das Ergebnis. Fragen Sie nochmal.

Wahrscheinlich bekommen Sie eine andere Liste. Forscher der Penn State dokumentierten 15 % Genauigkeitsabweichung bei identischen Prompts. Auch bei temperature=0. Gleiche Eingabe, anderes Ergebnis.

Wenn Ihnen ein AI Visibility Tool sagt "Ihre Markensichtbarkeit liegt bei 42 %": Wie oft wurde gefragt? Wie groß ist die Fehlermarge? Wie belastbar ist diese Zahl?

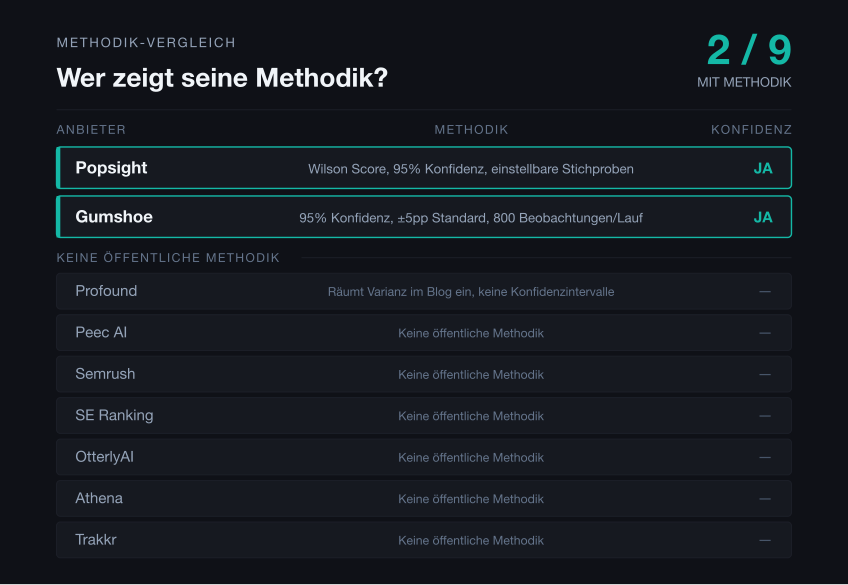

Wir haben 2026 acht Wettbewerber analysiert. Einer veröffentlicht Konfidenzintervalle. Für die anderen sieben fanden wir keine öffentliche Dokumentation zu Stichprobengrößen oder statistischer Unsicherheit.

Dieser Vergleich stellt Methodik in den Vordergrund. Wir haben die Tabelle gebaut, die wir selbst gebraucht hätten: nur öffentliche Quellen, mit Links wo verfügbar. Wir sind selbst Wettbewerber in dieser Kategorie (Popsight ist unser Produkt). Prüfen Sie alles, was Ihnen wichtig ist. Quellen und Einschränkungen stehen in den Anhängen.

Methodik sagt Ihnen, ob die Zahl stimmt. Readiness-Analysen sagen Ihnen, was Sie ändern können, wenn sie niedrig ist. Dieser Artikel behandelt beides.

Auf einen Blick

- Von acht Wettbewerbern veröffentlicht nur Gumshoe Konfidenzintervalle (in den Materialien, die wir gefunden haben).

- Mehrere Tools bieten Readiness-Audits, aber Tiefe und Dokumentation variieren stark.

- Popsight setzt auf lokale Messung plus Diagnose: Bot-Zugang, CMP-Erkennung, Zitationsanalyse und Quick Wins.

- Wie viele KI-Anbieter ein Tool abdeckt, ist weniger wichtig als ob die richtigen dabei sind.

Direkt zu: Was messen diese Tools? · Warum Methodik zählt · Käufer-Checkliste · Vergleichstabelle · Über Tracking hinaus · Tool-für-Tool · Methodik-Audit · Operational-Audit

Was ist ein AI Visibility Tool?

Ein AI Visibility Tool misst, wie oft Ihre Marke in KI-generierten Antworten erscheint. Sie definieren Prompts ("Was ist das beste CRM für kleine Unternehmen?"), das Tool fragt ChatGPT, Claude, Gemini, Perplexity ab und zeigt, wo und wie oft Ihre Marke genannt wird.

Klassisches SEO startet bei Seiten und Keywords. AI Visibility startet bei Prompts, generierten Antworten, zitierten Quellen und Markenerwähnungen.

Die Kategorie ist jung. Viele Anbieter haben Ende 2024 und 2025 auf KI-Sichtbarkeit umgestellt. 90 Mio. Dollar Venture Capital konzentrieren sich auf drei Anbieter: Profound hat 58,5 Mio. Dollar eingesammelt (Series B), Peec AI 29 Mio. Dollar (Series A), Athena 2,2 Mio. Dollar (Seed).

Pew Research zeigt: Nutzer, die eine KI-Zusammenfassung sehen, klicken nur noch zu 8 % auf klassische Suchergebnisse (vs. 15 % ohne). Ahrefs maß 58 % weniger Klicks bei Seiten mit AI Overview. ChatGPT allein hat 900 Mio. wöchentlich aktive Nutzer. Diese Studien zeigen, dass KI-Antworten den klassischen Suchtraffic kannibalisieren. Sie beweisen nicht, dass KI-Erwähnungen alle Markenentdeckung ersetzen. Aber sie machen Visibility in KI-Antworten relevant genug, um sie zu tracken.

Für mehr Kontext: unser Guide zu Generative Engine Optimization (GEO).

Warum Methodik wichtiger ist als Features

Die meisten AI Visibility Tools berichten Signal, ohne das Rauschen zu quantifizieren.

Ein Prompt, einmal durch ChatGPT geschickt, ist eine einzelne Stichprobe aus einer hochvariablen Verteilung. Vielleicht repräsentativ. Vielleicht ein Ausreißer. Sie können es nicht wissen.

Tools, die mehrfach samplen und Konfidenzintervalle berechnen, können Ihnen sagen: "Ihre Marke erscheint zu 45 % (±8 Prozentpunkte, 95 % Konfidenz)." Das ist eine Spanne von 37 % bis 53 %. Breit, aber ehrlich. Tools mit einer Abfrage geben Ihnen "45 %", Punkt. In Wirklichkeit könnten es 20 % oder 70 % sein.

Der Unterschied zählt bei Entscheidungen. Ihre Visibility fällt von 45 % auf 38 %. Hat sich etwas geändert? Mit Konfidenzintervallen prüfen Sie, ob die Bereiche überlappen. Überlappen sie: wahrscheinlich Rauschen. Überlappen sie nicht: etwas ist passiert. Ohne Intervalle raten Sie.

Von acht Wettbewerbern veröffentlicht nur Gumshoe diese Methodik. Die anderen sieben betonen Punktschätzungen, aber wir fanden keine Dokumentation zu Stichprobengrößen oder statistischer Unsicherheit.

Worauf Sie 2026 achten sollten

Bevor der Tool-Vergleich kommt: die Käufer-Checkliste.

Methodentransparenz

Veröffentlicht das Tool Stichprobengrößen und Konfidenzintervalle? Ohne könnte ein "45 % Sichtbarkeitswert" in Wahrheit zwischen 25 % und 65 % liegen. Dieser eine Filter trennt Messung von Raten.

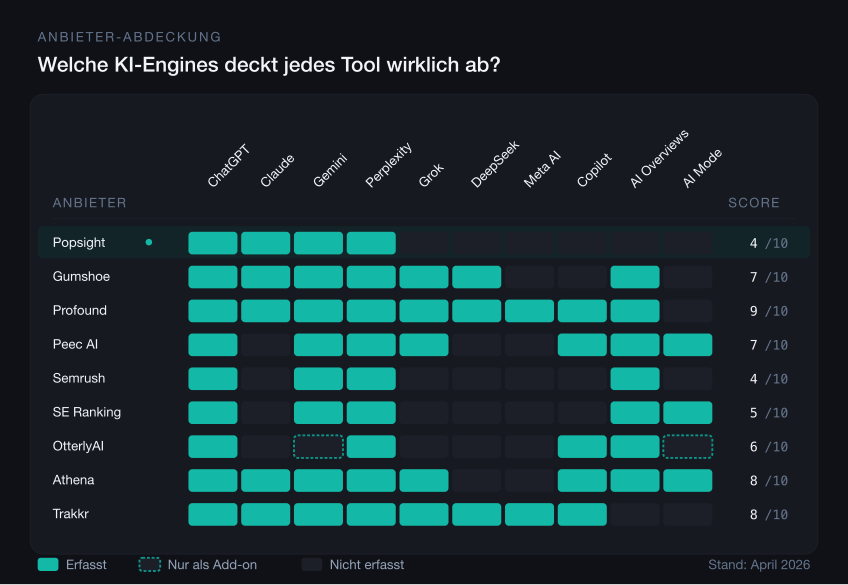

Anbieterabdeckung

ChatGPT und Perplexity sollten Minimum sein. Perplexity ist relevant, weil es zitatreiche Antworten bei Suchanfragen liefert und Kaufabsichts-Traffic abfängt ("beste X für Y"-Prompts). Claude, Gemini, Grok, DeepSeek und Meta AI trennen breite von eingeschränkter Abdeckung. Vorsicht bei Anbietern, die als "Roadmap" gelistet oder separat berechnet werden.

Mehr Engines heißt nicht bessere Abdeckung. Entscheidend ist, wo Ihre Käufer tatsächlich fragen. ChatGPTs Größe macht ChatGPT-Coverage wertvoller als exotische Engines.

Deployment

Cloud-SaaS speichert Prompts und Ergebnisse auf Anbieter-Servern. Desktop-Tools halten alles lokal. Bei Datenresidenz-Anforderungen oder Competitive Intelligence relevant.

Preisstruktur

Einstiegsstufen: 0 € (Trakkr Free) bis 499 $/Monat (Profound Lite). Enterprise oft bei 2.000-5.000 $+/Monat. Einige Anbieter verstecken Preise hinter Sales-Calls.

BYO-API-Keys

BYO-API (Bring Your Own API Keys): Sie zahlen Anbieter-Raten direkt (ca. 0,01-0,03 $ pro Abfrage). Vendor-Proxy-Preise können deutlich höher liegen, besonders bei niedrigem Volumen. Ein Vorbehalt: API-Antworten entsprechen nicht immer exakt dem Web-Interface.

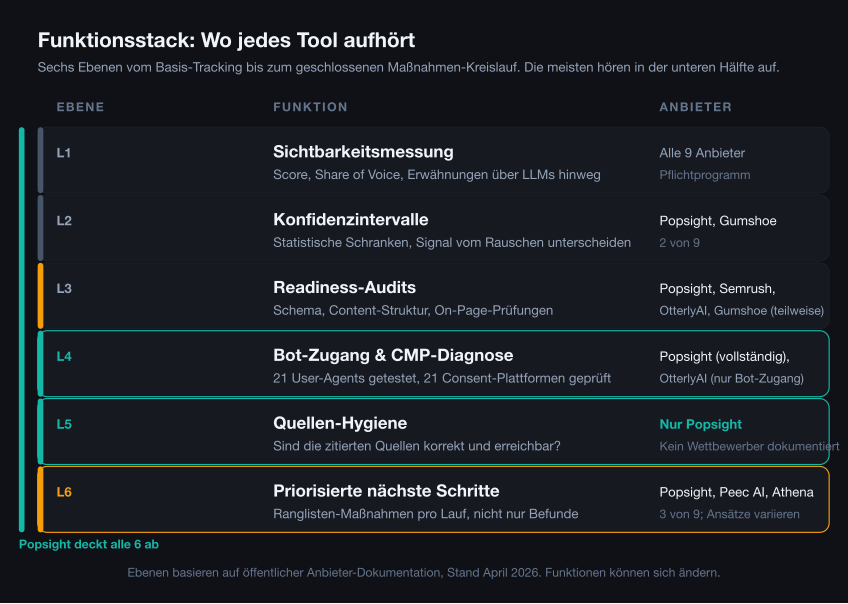

Aktion, nicht nur Monitoring

Ein Sichtbarkeitswert sagt, ob KI-Produkte Ihre Marke erwähnen. Nicht warum sie es nicht tun.

Manche Tools konzentrieren sich auf Messung. Andere verbinden Messung mit Diagnose: Crawler-Zugang, Bot-Blocks, Consent-Wall-Erkennung, Schema-Lücken, Zitations-URL-Status, Content-Klarheit. Wenn die Visibility niedrig ist: Sagt das Tool, was zu ändern ist? Oder starren Sie auf eine Zahl?

Alerts und Integrationen

Slack-Alerts bei Visibility-Einbruch. Looker Studio, GA-Integration. CSV-Export. Multi-Seat für Agenturen. Prüfen Sie, was heute verfügbar ist und was Roadmap.

Sicherheit und Governance

Größere Teams fragen nach SOC-2, SSO, RBAC und Audit-Logs. Datenaufbewahrung ist relevant, wenn Sie Competitive Intelligence nicht ewig auf fremden Servern haben wollen. Prüfen Sie, ob Prompts und Ergebnisse löschbar sind.

AI Visibility Tools im Vergleich

Diese Tabelle basiert auf direkter Prüfung der Preisseiten, Produktdokumentation und Marketingmaterialien, Stand April 2026.

Alle Preisangaben basieren auf öffentlich verfügbaren Quellen, Stand April 2026. Preise aus Drittquellen können sich geändert haben.

| Tool | Methodik | Anbieter | Einstiegspreis | Deployment | BYO-API |

|---|---|---|---|---|---|

| Popsight | 95 % KI, Wilson Score, konfigurierbare Samples, Trennung von Visibility- und Wahrnehmungs-Prompts | 4 (ChatGPT, Claude, Gemini, Perplexity) | Jahreslizenz (öffentlich) | Desktop (lokal) | Ja |

| Gumshoe | 95 % KI, 800 Beobachtungen/Lauf Standard, dokumentiert | 7+ (ChatGPT, Claude, Gemini, Perplexity, Grok, DeepSeek, AI Overviews) | Pay-as-you-go 0,10 $/Gespräch (öffentlich) | Cloud SaaS | Nein |

| Profound | Keine Angabe | 9 (ChatGPT, Claude, Gemini, Perplexity, Grok, DeepSeek, Meta AI, Copilot, AI Overviews) | ca. 399-499 $/Mo (Drittanbieter, nicht öffentlich) | Cloud SaaS | Nein |

| Peec AI | Keine Angabe | 7 (ChatGPT, Gemini, Perplexity, Copilot, Grok, AI Overviews, AI Mode) | ca. 85-90 €/Mo (Drittanbieter, nicht öffentlich) | Cloud SaaS | Nein |

| Semrush AI Toolkit | Keine Angabe | 4 (ChatGPT, Gemini, Perplexity, AI Overviews) | 99 $/Mo standalone (öffentlich) | Cloud SaaS | Nein |

| SE Ranking | Keine Angabe | 5 via SE Visible (ChatGPT, Perplexity, Gemini, AI Overviews, AI Mode); ältere Materialien zeigen engere Coverage | ca. 63-89 €/Mo je nach Region (öffentlich) | Cloud SaaS | Nein |

| OtterlyAI | Keine Angabe | 4-6 (ChatGPT, Perplexity, Copilot, AI Overviews; Gemini, AI Mode als Add-ons) | 29 $/Mo (öffentlich) | Cloud SaaS | Nein |

| Athena | Keine Angabe | 8 (ChatGPT, Claude, Gemini, Perplexity, Copilot, Grok, AI Overviews, AI Mode) | ca. 95-295 $/Mo (Reviews, unbestätigt) | Cloud SaaS | Nein |

| Trakkr | Keine Angabe | 8 (ChatGPT, Claude, Gemini, Perplexity, Grok, DeepSeek, Meta AI, Copilot) | Free-Tier 0 $ (öffentlich) | Cloud SaaS | Nein |

Die Methodik-Spalte ist der entscheidende Filter. Von acht Wettbewerbern veröffentlicht nur Gumshoe Konfidenzintervalle. Ihr Methodik-Blogpost dokumentiert 800 Beobachtungen pro Lauf, ±5pp bei 95 % KI, bei Multi-Run ±2,5pp. Die anderen sieben zeigen "Share of Voice"-Punktwerte, aber keine Dokumentation zu Stichprobengrößen oder statistischer Varianz.

Profounds Blog erwähnt Variabilität ("LLM tools don't give the same answer every time to every user"). Wie Profound diese Variabilität kontrolliert, ist nicht öffentlich dokumentiert.

Keiner der acht Wettbewerber bietet BYO-API-Keys, Desktop-Deployment oder Jahreslizenz (statt Monatsabo).

Kurzurteil nach Anwendungsfall

| Anwendungsfall | Beste Wahl |

|---|---|

| Dokumentierte Methodik | Gumshoe |

| Breiteste Coverage / Enterprise | Profound |

| Europa / Multi-Länder | Peec AI |

| Free-Tier | Trakkr |

| Bestehende SEO-Suite | Semrush oder SE Ranking |

| Lokal / BYO-API | Popsight |

Über Visibility-Tracking hinaus

Die Tabelle oben vergleicht Messung. Aber ein niedriger Score wirft die Folgefrage auf: Warum?

Diese Tabelle zeigt operative Fähigkeiten jenseits des Kern-Trackings. "(öffentliche Docs)" heißt: aus Anbieterdokumentation. "(Drittanbieter)" heißt: aus Reviews, ohne Anbieterbestätigung. "Nicht dokumentiert" heißt: keine öffentlichen Belege gefunden. Fehlende Dokumentation bedeutet nicht: Feature fehlt.

Wettbewerber-Erkennung: Kann das Tool Wettbewerber aus KI-Antworten oder Zitationen vorschlagen? "Manuell" = Sie müssen jeden eingeben. "Semi-automatisch" = Tool schlägt vor, Sie wählen. "Auto-Discovery" = Tool findet Wettbewerber selbst.

| Tool | Readiness-Audit | Bot-Checks | Zitationsgesundheit | Wettbewerber-Erkennung |

|---|---|---|---|---|

| Popsight | In-App: 50+ Checks (Crawler-Zugang, Renderability, Schema, Content-Klarheit); Feature-Seite in Vorbereitung | In-App: 21 KI-Crawler User-Agents | In-App: prüft zitierte URLs auf Redirects, noindex, HTTP-Fehler | Observed Actors aus Zitationsdomains |

| Gumshoe | AIO Score, Page Audit: Schema, JSON-LD, Metadaten, Headings (Docs) | Nur allgemeines robots.txt | Nicht dokumentiert | Hybrid: KI schlägt vor, Nutzer konfiguriert (bis 30) |

| Profound | Teilweise: Agent Analytics via CDN-Logs | Nicht dokumentiert | Nicht dokumentiert | Nicht dokumentiert |

| Peec AI | Nicht dokumentiert | Nicht dokumentiert | Nicht dokumentiert | Auto-Discovery bei 2+ Erwähnungen |

| Semrush | AI Search Checks im Site Audit (Docs); robots.txt/llms.txt/Schema via Drittanbieter berichtet | Berichtet: 8+ KI-Crawler (Drittanbieter) | Nicht dokumentiert | Semi-automatisch |

| SE Ranking | Nur allgemeines SEO-Audit | Standalone robots.txt-Tester (nicht integriert) | Nicht dokumentiert | Manuell (bis 5) |

| OtterlyAI | GEO Audit: 20+ Faktoren (Docs) | Ja: robots.txt + Crawler Simulation (Docs) | Nicht dokumentiert | Nicht dokumentiert |

| Athena | Schema/Content-Gap erwähnt | Erwähnt, Details fehlen | Nicht dokumentiert | Details fehlen |

| Trakkr | Teilweise: Bildungsinhalte | Nur Checklisten | Nicht dokumentiert | Auto (2+ Co-Mentions) + manuell |

llms.txt ist ein aufkommendes Format für KI-Crawler-Steuerung, ähnlich robots.txt, aber noch kein Standard.

Mehrere Tools bieten Readiness-Audits. Popsight kombiniert lokale Messung, statistische Validierung, KI-Crawler- und CMP-Diagnostik, Zitations-URL-Checks und Post-Run-Aktionsempfehlungen in einem Workflow.

Einen vergleichbaren Zitations-URL-Check fanden wir bei keinem Wettbewerber dokumentiert: HTTP-Validierung von URLs, die KI-Systeme von Ihrer Domain zitieren (Redirects, noindex/nosnippet, HTTP-Fehler, Stale-Page-Signale). Typischer Fehlermodus: ChatGPT zitiert Ihre Preisseite, aber die trägt einen X-Robots-Tag: noindex von einer Vercel-Preview-Promotion.

Tool-für-Tool-Analyse

Profound

Der Blog räumt Variabilität ein: "LLM tools don't give the same answer every time to every user." Wie Profound das kontrolliert? Nicht dokumentiert. Sie zeigen die Zahl, aber keine Stichprobengrößen oder Konfidenzintervalle.

Profound hat 58,5 Mio. Dollar eingesammelt (Khosla, Kleiner Perkins, Sequoia). Neun Engines inklusive Claude, Grok, DeepSeek und Meta AI. Kunden laut Website: Ramp, US Bank, Indeed, MongoDB, DocuSign.

Preise nur auf Anfrage. Reviews berichten Einstieg bei 399-499 $/Monat für begrenzte Prompts, Enterprise bei 2.000-5.000 $+/Monat. Kein Free Trial, keine Self-Serve-Anmeldung. SOC 2 und SSO für Enterprise. GA-Integration.

Für Käufer, die Engine-Abdeckung, Integrationen und Enterprise-Support priorisieren, gehört Profound auf die Shortlist.

Peec AI

Berlin-basiert. Relevant für europäische Käufer mit DSGVO- und Datenresidenz-Anforderungen.

29 Mio. Dollar (Antler, 20VC, Singular). Sieben Engines inklusive Grok. Multi-Länder-Tracking für europäische Märkte. 1.300+ Kunden, angeblich 300+ neue pro Monat.

Preise werden erst nach dem Anmeldeprozess angezeigt, nicht auf einer öffentlichen Preisseite. Reviews (Stand April 2026) deuten an: Starter ca. 85-90 €/Mo, Pro ca. 199-205 €/Mo, Advanced ca. 425 €/Mo. Kein Claude im Standard-Tier. Keine dokumentierte Methodik.

Semrush AI Visibility Toolkit

Eine der größten SEO-Plattformen, eine der engsten Engine-Listen.

Vier Engines: ChatGPT, Gemini, Perplexity, AI Overviews. Kein Claude, kein Grok, kein DeepSeek im Standard-Tier. Keine dokumentierte Methodik.

99 $/Mo standalone (25 Prompts) oder gebündelt ab 199 $/Mo. Kein Free Trial für das Standalone-Toolkit. Wer Semrush schon nutzt: CSV-Export, kein Tool-Wechsel. Wer von null startet: die enge Coverage ist schwer zu rechtfertigen.

SE Ranking

SE Rankings Materialien variieren nach Produkt und Paket. SE Visible listet aktuell AI Mode, AI Overviews, Gemini, Perplexity, ChatGPT. Ältere AI-Tracker-Referenzen zeigen engere Coverage (4 Engines, Claude und Gemini "nur Roadmap").

Ca. 63-89 €/Mo Add-on (erfordert Core-Plan bei 87-188 €/Mo). Free Trial ohne Kreditkarte. Wer SE Ranking schon nutzt: einfaches KI-Tracking ohne Plattformwechsel. Keine dokumentierte Methodik.

OtterlyAI

Bootstrapped. In einer Kategorie mit stark finanzierten Wettbewerbern bemerkenswert für transparente Preise und Partnerschaften.

Gartner Cool Vendor 2025. Partnerschaft mit Semrush. 25.000+ Marketer auf der Plattform.

Lite: 29 $/Mo (15 Prompts). Quellen widersprechen sich bei höheren Tiers: Standard ca. 160-189 $/Mo (100 Prompts), Premium ca. 422-489 $/Mo (400 Prompts). Free Trial. Looker-Studio-Integration. Agentur-Partnerprogramm. Claude, Grok, DeepSeek nicht im Basis-Tier. Gemini und AI Mode als Add-ons. Keine dokumentierte Methodik.

Athena

95 $/Mo oder 295 $/Mo? Quellen berichten beides. Enterprise custom. Preise direkt bestätigen vor dem Vergleich.

Gründer von Google Search und DeepMind. 2,2 Mio. Dollar via Y Combinator. Acht Engines inklusive Claude und Grok.

Marketing betont Fallstudien ("6X Share of Voice Lift"). Wie diese Zahlen berechnet wurden? Nicht dokumentiert.

Trakkr

0 $/für immer. Eine Marke. Fünf Prompts. Sechs Modelle. Echtes Free-Tier.

Growth: 79 $/Mo. Scale: 399 $/Mo mit White-Label und API für Agenturen. Acht Engines insgesamt. MCP-Server im Scale-Tier für Agent-Workflows.

Keine dokumentierte Methodik. Trakkr veröffentlicht eigene Wettbewerbervergleiche, also: als Anbieter-Content behandeln. Agenturen können mit dem Free-Tier starten.

Gumshoe

Einziger Wettbewerber neben Popsight mit öffentlichem Methodik-Anspruch: 95 % KI, ±5pp Standard, 800 Beobachtungen pro Lauf, ±2,5pp bei Multi-Run. Persona-gestütztes Sampling.

7+ Engines. Kostenloser Baseline-Report zur Evaluierung. Danach Pay-as-you-go bei 0,10 $ pro Gespräch.

Die Tradeoffs: Cloud statt Desktop, Vendor-Proxy statt BYO-API, metered statt Jahreslizenz. Bei hohem Volumen summiert sich das. Aber die statistische Strenge ist da.

Popsight

Unser Produkt. Diesen Abschnitt als Anbieter-Content behandeln.

Der Unterschied: Popsight verbindet Messung mit Handlungsempfehlungen. ChatGPT, Claude, Gemini und Perplexity mit BYO-API-Keys. Wilson-Score-Konfidenzintervalle. Trennung von Visibility-Prompts ("Was ist das beste CRM?") und Wahrnehmungs-Prompts ("Was wissen Sie über Acme?"), damit Letztere den Score nicht aufblähen.

Der In-App Readiness-Scan prüft:

- Crawler-Zugang und Bot-Blocking (21 User-Agents)

- JavaScript-Renderability

- Technische Hygiene

- Strukturierte Daten (17 Schema-Typen)

- Multi-Page-Crawl und Link-Depth

- Content-Klarheit für Retrieval

Dazu: Fingerprinting von 21 Consent-Plattformen, Chrome- vs. GPTBot-Vergleich für CMP-Erkennung, und HTTP-Validierung zitierter URLs (Redirects, noindex, Fehler).

Nach jedem Lauf: Quick Wins ohne zusätzliche LLM-Kosten. Prompts, bei denen Wettbewerber dominieren. Prompts, bei denen Sie genannt werden, aber nie auf Platz eins. Zitationslücken. Observed Actors findet Marken, die KI-Produkte neben Ihnen nennen, aber nicht auf Ihrer Tracking-Liste stehen.

Der Tradeoff: Popsight hat weniger Engines (4 vs. 8-9 bei Profound, Athena, Trakkr). Wer die breiteste Coverage oder Enterprise-Workflows braucht: diese Tools passen besser. Wer lokale Messung plus konkrete Empfehlungen in einer Oberfläche will: dafür ist Popsight gebaut.

Weitere Tools

Diese Anbieter tauchten in der Recherche auf, aber ohne genug öffentliche Information für den Hauptvergleich:

Scrunch AI (1.900 Branded Search Volume): Influencer- und Social-Analytics mit einigen AI Visibility Features.

Amplitude (Product Analytics): Hat ein "AI visibility" Feature, aber auf Product Analytics ausgerichtet, nicht Brand Monitoring.

Ahrefs: AI Visibility angekündigt, aber Produktdokumentation dünn.

Daydream: "SEO agents" plus Expert Services. Eher Hybrid-SaaS als reines Tool.

WordLift und xFunnel AI: Erscheinen in Long-Tail-Suchen, wenig öffentliche Informationen.

BrandRank.AI: Enterprise-fokussiert, von Pete Blackshaw (ex-P&G/Nestlé). Sieben Engines mit DeepSeek und Meta AI. Kunden laut Website: Nestlé, P&G, Fifth Third Bank. Preise nicht öffentlich. Keine dokumentierte Methodik.

Head-to-Head: Peec AI vs Profound

Die beiden bestfinanzierten Enterprise-Anbieter im Vergleich: 29 Mio. vs. 58,5 Mio. Dollar. Direkteste Wettbewerber im Enterprise-Segment.

Coverage: Profound gewinnt (9 vs. 7 Engines). Profound hat Claude; Peec nicht im Standard-Tier.

Preistransparenz: Beide verstecken Preise hinter Sales-Calls. Reviews deuten an: Profound startet höher (399-499 $/Mo vs. ca. 85-90 €/Mo für Peec Starter).

Methodik: Keiner veröffentlicht Konfidenzintervalle oder Stichprobengrößen.

Geografie: Peec ist Berlin-basiert mit EU-Hosting. Profound US-basiert. Relevant für DSGVO und Datenresidenz.

Marktposition: Profound zielt auf US-Enterprise mit Fortune-500-Logos. Peec auf europäische Marken mit Multi-Länder-Tracking.

Wo Popsight anders ist: Desktop (Daten bleiben lokal), BYO-API-Keys (Anbieter-Raten direkt), Jahreslizenz statt Monatsabo, dokumentierte Wilson-Score-Konfidenzintervalle, Prompt-Trennung und ein Readiness-Scan, der niedrige Visibility in konkrete Maßnahmen übersetzt.

Free vs Paid AI Visibility Checker

Noch nicht bereit für bezahlt? Was es wirklich im Free-Tier gibt:

Trakkr Free (0 $/für immer): 1 Marke, 5 Prompts, 6 Modelle, 1 Artikel/Monat. Einziges echtes Freemium im Markt.

OtterlyAI Free Trial: Zeitbegrenzt für neue Nutzer. Konvertiert zu bezahlt.

Gumshoe Free Baseline: Ein Report zur Evaluierung. Pay-as-you-go danach.

Popsight 14-Tage-Trial: Voll funktional, alle Engines, keine Kreditkarte. BYO-API heißt: nur Anbieterkosten während des Trials.

SE Ranking Free Trial: Ohne Kreditkarte für Core-SEO. KI-Add-on inklusive.

Manuelle Stichproben: Prompts selbst in ChatGPT, Claude, Perplexity eingeben. Kostenlos, aber eine Handvoll Checks kann Signal nicht von Varianz trennen (siehe warum KI Konfidenzintervalle braucht).

So verbessern Sie Ihre AI Visibility

Häufige Crawl-, Indexierungs- und Retrieval-Fehlermodi. Teils dokumentiertes Plattformverhalten, teils Heuristiken zum Testen.

Bot-Zugang

robots.txt, die KI-Bots explizit erlaubt. Cloudflares AI-Crawlers-Toggle blockiert GPTBot, ClaudeBot, PerplexityBot auf CDN-Ebene und überschreibt robots.txt. Prüfen: Security > Bots > AI Crawlers.

KI-Crawler im Consent-Banner whitelisten. GPTBot klickt nicht "Akzeptieren". Ein CMP, das Inhalte hinter Consent versteckt, lässt Crawler die Consent-UI indexieren statt Ihre Inhalte.

JavaScript-SPAs serverseitig rendern. GPTBot führt kein clientseitiges JS aus. Eine React-SPA sieht für Crawler wie eine leere Hülle aus.

Strukturierte Daten

Organization-JSON-LD mit sameAs-Links zu Wikipedia, LinkedIn, Crunchbase, GitHub, X. Yext zeigt: 86 % der KI-Zitationen kommen von Quellen, die Marken schon kontrollieren.

dateModified bei Article- und BlogPosting-Schema. Ohne fällt Retrieval auf datePublished zurück, was Inhalte veraltet wirken lässt.

X-Robots-Tag: noindex prüfen. Vercel- und Netlify-Previews tragen oft diesen Header nach Promotion zu Produktion. Überschreibt alles im HTML.

Content-Klarheit

Meta-Description (50-160 Zeichen) auf jeder Seite. KI-Produkte zitieren sie manchmal wörtlich.

nosnippet und max-snippet

entfernen. Google schließt Seiten mit diesen Tags von AI Overviews aus (Dokumentation).FAQ-Abschnitte mit FAQPage-Schema. Q&A-Formulierungen spiegeln oft, wie Nutzer fragen.

Absätze, die alleine stehen. KI-Retrieval zieht Passagen aus dem Kontext. "Außerdem" oder "wie oben erwähnt" zeigen auf nichts. Konkrete Zahlen, wo relevant.

Die Käuferfrage

Nicht "welche Tools tracken die meisten Engines?" Sondern "welchen Zahlen kann ich vertrauen?" Wenn ein Anbieter Ihnen nicht Stichprobengröße, Konfidenzintervall und Varianz-Handling nennen kann: Score als Richtungsanzeige behandeln, mehr nicht.

FAQ

Was ist ein AI Visibility Score?

Sie fragen ChatGPT 50 Mal nach "beste Projektmanagement-Software für Remote-Teams". Ihre Marke erscheint in 23 Antworten. Das sind 46 % Visibility für diesen Prompt.

Ohne Stichprobengröße keine Zuverlässigkeit. "46 %" basierend auf 5 Samples könnte real 25 % oder 70 % sein. Fragen Sie immer nach der Stichprobengröße.

Gibt es ein kostenloses AI Visibility Tool?

Trakkr hat echtes Free-Tier: 0 $/für immer, 1 Marke, 5 Prompts, 6 Modelle. OtterlyAI, SE Ranking, Popsight bieten Free Trials. Gumshoe einen kostenlosen Baseline-Report.

Alternativ: Prompts manuell in ChatGPT, Claude, Perplexity eingeben. Aber eine Handvoll Checks kann Signal nicht von Varianz trennen.

Funktionieren AI Visibility Tools?

Sie messen etwas Reales. Ob der Score zuverlässig ist, hängt von der Methodik ab, die viele nicht veröffentlichen.

Tools mit mehreren Samples und Konfidenzintervallen produzieren eher entscheidungsnützliche Daten. Ohne Transparenz ist Signal von Rauschen nicht zu unterscheiden.

Was ist der Unterschied zwischen AI Visibility und SEO?

SEO ist vergleichsweise stabil. AI Visibility ist stochastischer: gleicher Prompt, verschiedene Antworten.

Beide kümmern sich um strukturierte Daten, Crawl-Zugang, Content-Qualität. Aber AI Visibility erfordert Sampling, weil Einzelantworten unzuverlässig sind. Der Begriff dafür: Generative Engine Optimization (GEO).

Was ist mit Claude, Grok und DeepSeek?

Engine-Liste prüfen. Profound und Trakkr: 8-9 Engines. SE Ranking: 4-5 je nach Paket. Semrush lässt Claude, Grok, DeepSeek im Standard-Tier aus.

Wie oft analysieren?

Frequenz ist weniger wichtig als Stichprobengröße. Wöchentlich mit 50 Samples pro Prompt schlägt täglich mit 5.

Für Trends: ab 20+ Samples nützlich. Nötige Stichprobengröße hängt von Rate und akzeptabler Fehlermarge ab. Für Einmal-Audits: mehr ist besser.

Anhang: Methodik-Audit

Was wir gefunden haben (und nicht gefunden haben) bei der Suche nach öffentlich dokumentierter statistischer Methodik. Die zentrale Behauptung: Die meisten AI Visibility Tools dokumentieren keine Konfidenzintervalle oder Stichprobengrößen. Behauptungen über fehlende Evidenz erfordern Belege.

| Anbieter | Geprüfte Quellen | Methodik? | Anmerkungen |

|---|---|---|---|

| Popsight | In-App, Preise | Ja | 95 % KI, Wilson-Score; konfigurierbare Samples; in-App dokumentiert; öffentliche Seite in Vorbereitung |

| Gumshoe | Blog, Preise | Ja | 95 % KI, ±5pp, 800 Beobachtungen/Lauf, ±2,5pp bei Multi-Run |

| Profound | Blog, Help, Produkt | Nein | Blog erwähnt Variabilität, keine Samples/KIs dokumentiert |

| Peec AI | Website, Docs | Nein | Nichts gefunden |

| Semrush AI Toolkit | Toolkit, Preise | Nein | Nichts gefunden |

| SE Ranking | Tracker, Preise | Nein | Nichts gefunden |

| OtterlyAI | Preise, Hilfe | Nein | Nichts gefunden |

| Athena | Produkt, YC | Nein | Fallstudien mit Lift-Metriken, keine Methodik |

| Trakkr | Preise, Features | Nein | Nichts gefunden |

Stand: April 2026. Wenn Sie einen hier genannten Anbieter vertreten und der Meinung sind, dass wir Ihre Methodendokumentation übersehen oder falsch dargestellt haben, kontaktieren Sie uns bitte. Wir prüfen Ihre Angaben und aktualisieren diesen Artikel entsprechend.

Anhang: Operational Capability Audit

Was wir zu operativen Fähigkeiten jenseits des Kern-Trackings gefunden haben. Nicht-dokumentierte Quellen markiert.

| Anbieter | Quellen | Readiness | Bot-Checks | Zitationen | Wettbewerber |

|---|---|---|---|---|---|

| Popsight | In-App (Feature-Seite in Vorbereitung) | Ja | Ja | Ja | Observed Actors |

| Gumshoe | llminfo.md, Preise | AIO Score, Page Audit | Nur robots.txt | – | Hybrid |

| Profound | Blog, Help, Produkt | Teilweise (Agent Analytics) | – | – | – |

| Peec AI | Website, Docs | – | – | – | 2+ Erwähnungen |

| Semrush | KB, Drittanbieter | AI-Search (Docs + Drittanbieter) | 8+ Crawler (berichtet) | – | Semi-auto |

| SE Ranking | Tracker, Preise | – | Standalone-Tool | – | – |

| OtterlyAI | GEO Audit, Crawlability | GEO Audit | Ja | – | – |

| Athena | Produkt, YC | Erwähnt | Erwähnt | – | Unklar |

| Trakkr | Preise, Features | Nur Bildungsinhalte | – | – | Auto + manuell |

Stand: April 2026.

Einschränkungen

Nur öffentliche Materialien geprüft. Anbieter zeigen ggf. mehr in Sales-Calls, Kundendokumentation oder In-App-Screens. "–" heißt: nicht öffentlich dokumentiert, nicht: Feature fehlt.

Alle genannten Produktnamen und Marken Dritter sind Eigentum ihrer jeweiligen Inhaber.

Popsight: Desktop, BYO-API, Wilson-Score-Konfidenzintervalle, Readiness-Scan. Wenn das zu Ihren Anforderungen passt: 14-Tage-Trial.