AI Visibility ist nicht ein Problem. Es sind vier.

Wer seine Marke auf KI-Sichtbarkeit optimiert, behandelt "KI" meist als einen einzigen Kanal. Das ist ein Fehler.

Wir haben eine umfassende Studie mit ChatGPT (OpenAI), Claude (Anthropic), Gemini (Google) und Perplexity durchgeführt, um zu messen, wie konsistent jede KI-Engine dieselben Marken erwähnt. Die kurze Antwort: Sie stimmen nicht überein. Nicht einmal annähernd.

53 % aller paarweisen Provider-Vergleiche zeigten statistisch signifikante Unterschiede in der Brand Visibility. Der durchschnittliche Abstand zwischen dem besten und dem schlechtesten Provider einer Marke lag bei 22 Prozentpunkten.

Dieser Artikel führt durch den gesamten Datensatz: Was wir getestet haben, was wir gefunden haben und was das für Ihre Strategie zur Generative Engine Optimization bedeutet.

Studiendesign: 3.837 API-Calls, 16 Brands, 4 Provider

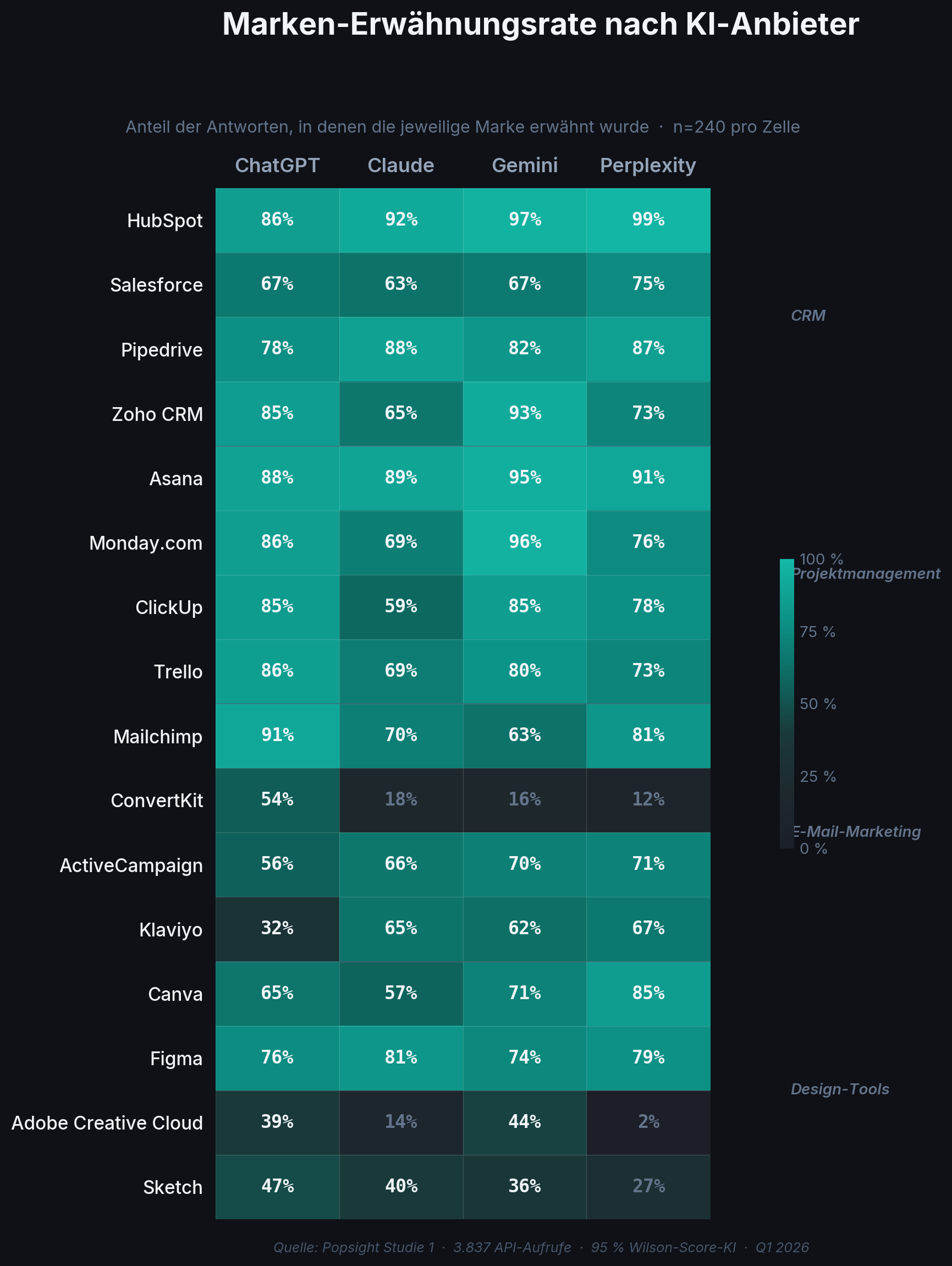

Wir haben 16 Marken in vier SaaS-Kategorien getestet: CRM, Projektmanagement, E-Mail-Marketing und Design Tools. Jede Marke wurde mit 12 verschiedenen Prompt-Typen und 20 Samples pro Provider getestet, insgesamt 3.837 validierte API-Calls. Jeder Datenpunkt erfüllte unser Kriterium für robuste statistische Validität (n>=100 pro Zelle).

Die getesteten Provider waren OpenAI GPT-4.1-mini, Anthropic Claude Haiku, Google Gemini Flash Lite und Perplexity Sonar. Die untersuchten Marken umfassen HubSpot, Salesforce, Zoho CRM, Pipedrive, Asana, Monday.com, ClickUp, Trello, Mailchimp, ConvertKit, Klaviyo, ActiveCampaign, Canva, Figma, Adobe Creative Cloud und Sketch.

Alle Modelle hatten Live-Websuche aktiviert. Bei allen vier Providern war das jeweilige Web-Search- bzw. Grounding-Tool eingeschaltet, sodass jedes Modell bei der Antwortgenerierung auf aktuelle Webergebnisse zugreifen konnte. Die Unterschiede in dieser Studie entstehen nicht dadurch, dass manche Modelle Internetzugang hatten und andere nicht. Alle hatten ihn. Sie kamen trotzdem zu unterschiedlichen Ergebnissen.

Die Heatmap: Ein Flickenteppich, kein Muster

Was beim ersten Blick auf die Daten sofort auffällt, ist die Ungleichmäßigkeit. Es gibt keine einheitliche "AI Visibility."

Auf aggregierter Ebene liegen die vier Provider näher beieinander als erwartet:

| Provider | Durchschn. Presence Rate |

|---|---|

| Google (Gemini) | 71 % |

| OpenAI (ChatGPT) | 70 % |

| Perplexity | 67 % |

| Anthropic (Claude) | 63 % |

Doch diese Durchschnittswerte verschleiern enorme Unterschiede auf Brand-Ebene. Die eigentliche Geschichte ist nicht, dass ein Provider "besser" ist. Sondern dass jeder Provider sein eigenes Muster hat, welche Marken er hervorhebt und welche er ignoriert.

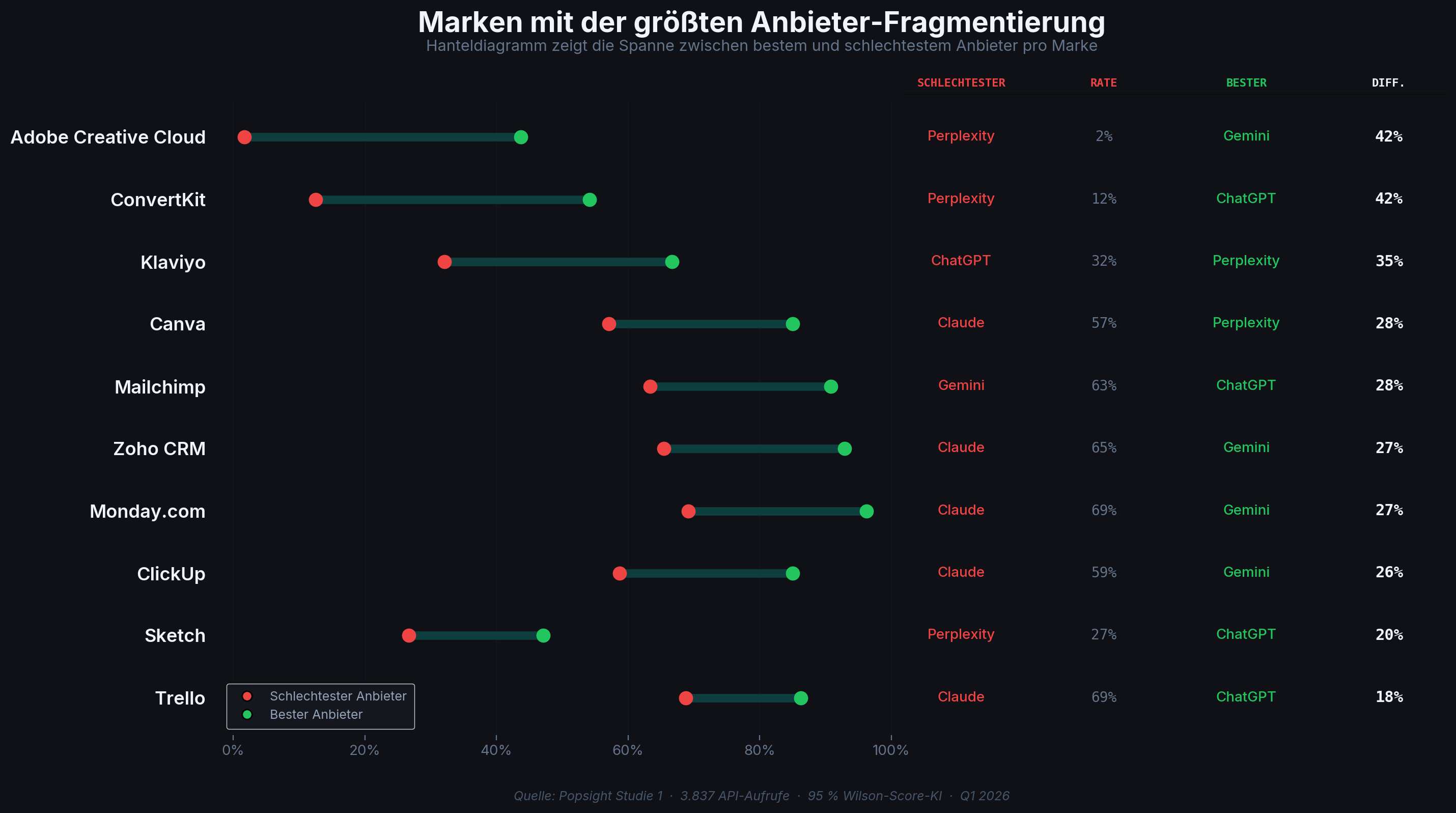

Die am stärksten fragmentierten Brands

Einige Marken haben eine völlig inkonsistente Sichtbarkeit, je nachdem welche KI-Engine ein Nutzer gerade verwendet.

Die auffälligsten Fälle:

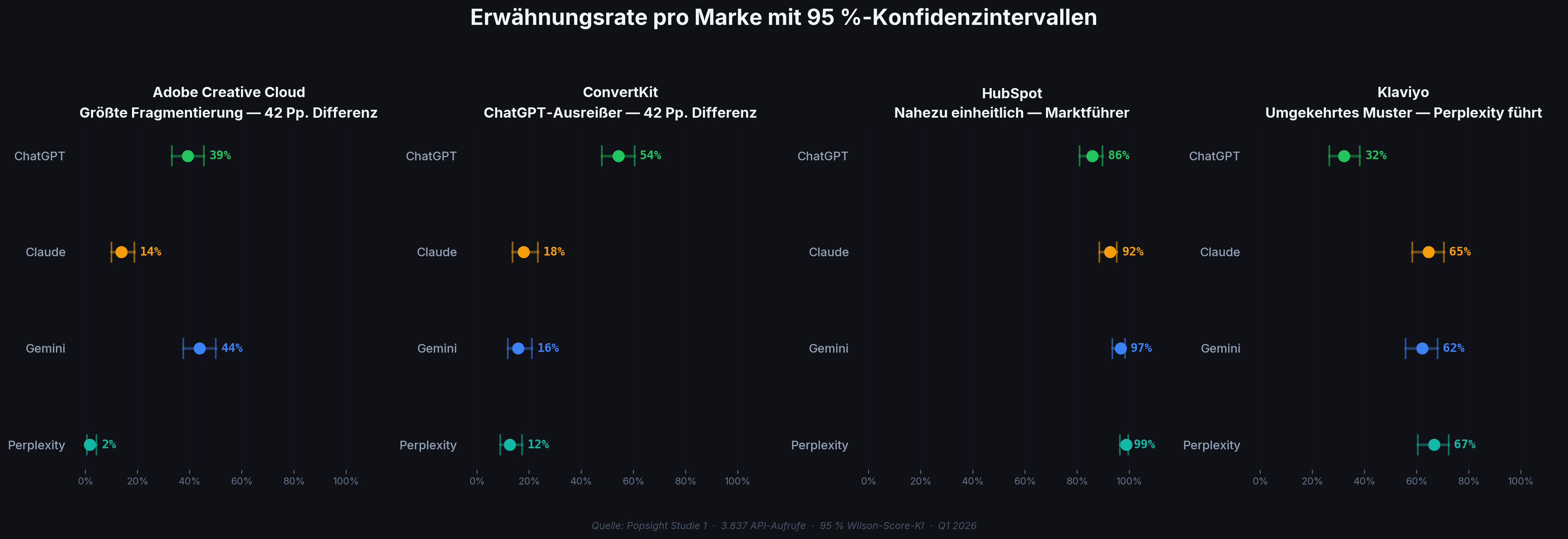

- Adobe Creative Cloud: Google erwähnt die Marke in 44 % der Fälle. Perplexity? 2 %. Das ist ein Abstand von 42 Prozentpunkten. Adobe ist auf einer der am schnellsten wachsenden KI-Suchplattformen praktisch unsichtbar.

- ConvertKit: OpenAI liefert eine Presence Rate von 54 %. Bei Perplexity, Claude und Gemini liegt sie zwischen 12 % und 16 %. Wer sich darauf verlässt, dass ConvertKit in KI-Antworten auftaucht, erreicht nur einen Bruchteil der Nutzer.

- Klaviyo: Das umgekehrte Muster. Perplexity zeigt Klaviyo in 67 % der Fälle, während OpenAI nur auf 32 % kommt. Gleiche Kategorie, gleiche Prompts, komplett andere Gewinner.

- Canva: Überall stark, aber nicht gleich stark. Perplexity liefert 85 % Visibility, Anthropic nur 57 %. Ein Spread von 28 Punkten bei einer Marke, von der die meisten annehmen würden, sie "taucht einfach auf."

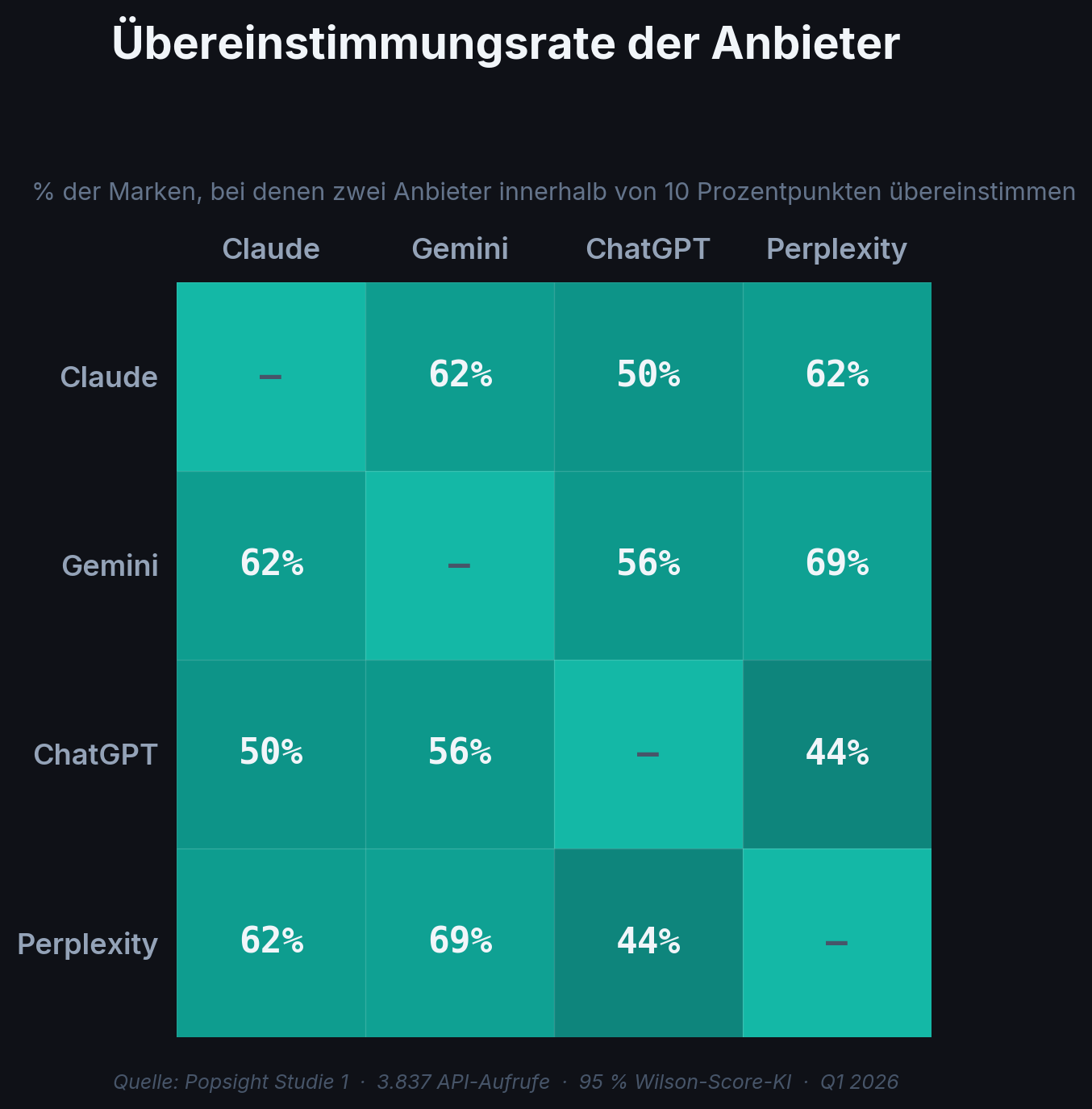

Stimmen die Provider überhaupt überein?

Wir haben gemessen, wie oft zwei beliebige Provider bei der Sichtbarkeit einer Marke innerhalb von 10 Prozentpunkten übereinstimmen. Die Ergebnisse zeigen, wie fragmentiert die Landschaft wirklich ist.

Genau deshalb vermittelt das Tracking auf nur einem KI-Provider ein falsches Sicherheitsgefühl. Zwei Provider, die dieselbe Marke betrachten und dieselben Fragen gestellt bekommen, können völlig unterschiedliche Bilder liefern.

Die HubSpot-Ausnahme (und warum sie selten ist)

HubSpot war in unserem Datensatz das, was einem Konsens am nächsten kommt. Perplexity erwähnt es in 99 % der Fälle, und selbst der niedrigste Wert (86 % bei OpenAI) ist dominant.

Aber HubSpot ist die Ausnahme, nicht die Regel.

Die Marken, bei denen die Provider am stärksten übereinstimmten, waren in der Regel klare Category Leader mit einer grossen Web-Präsenz. Die Marken mit der größten Abweichung waren tendenziell Mid-Market- oder Nischen-Player, also genau die Marken, die am meisten davon profitieren würden, diese Dynamiken zu verstehen.

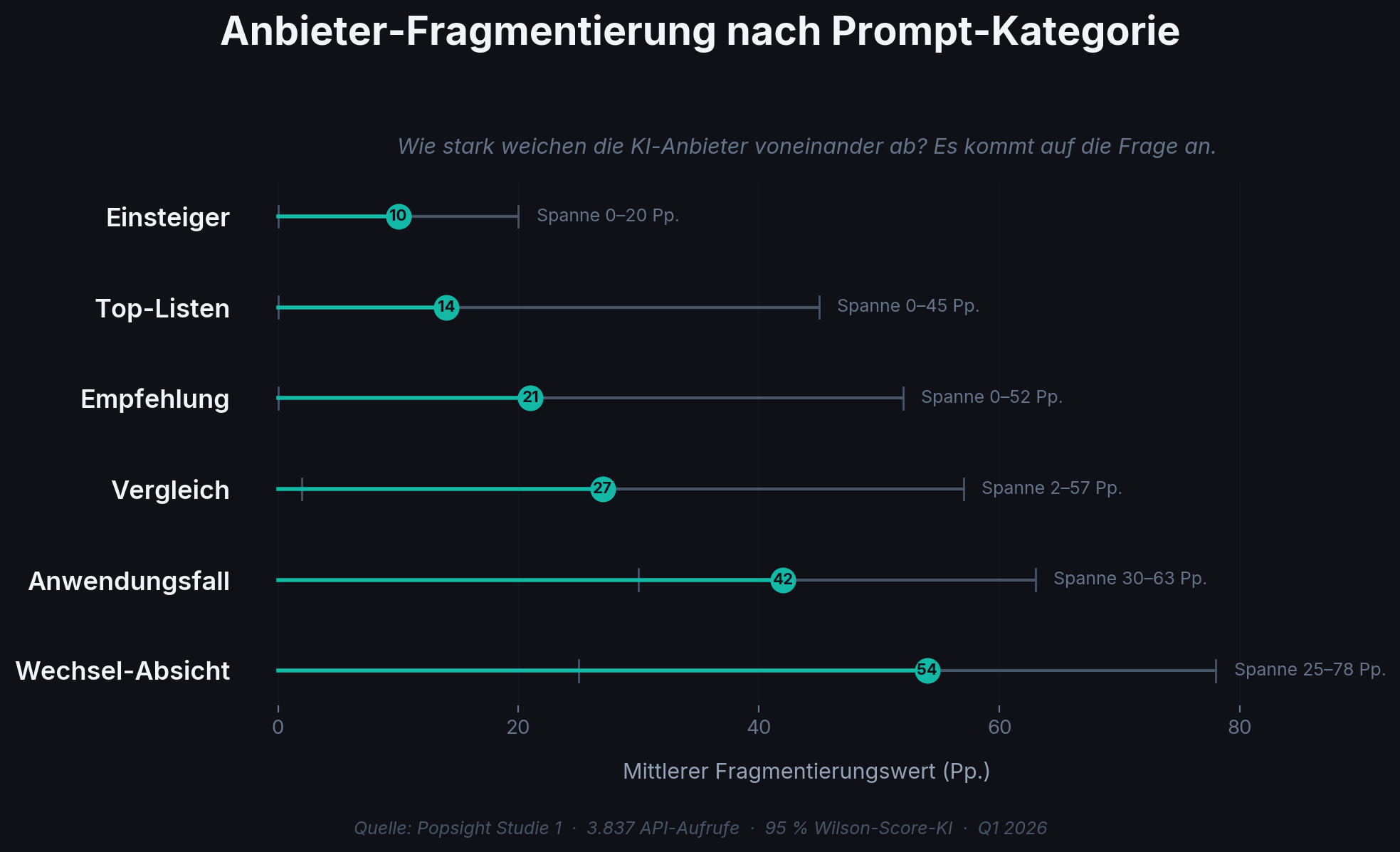

Prompt-Typ ist wichtiger als gedacht

Wir haben 12 Prompt-Typen getestet, von direkten Empfehlungsanfragen ("Was ist das beste CRM?") über Vergleichs-Prompts ("Vergleiche X und Y") bis hin zu Wechsel-Prompts ("Ich wechsle von X, was sollte ich ausprobieren?").

Wechsel-Prompts erzeugten die größte Fragmentierung über alle Provider hinweg. Wenn ein Nutzer eine KI nach Alternativen zu einem Produkt fragt, ist die Variation bei den vorgeschlagenen Alternativen extrem.

Das ist relevant, weil Wechselabsicht High-Intent-Traffic ist. Diese Nutzer suchen aktiv nach einer neuen Lösung. Wenn Ihre Marke bei diesen Anfragen auf einer KI-Engine auftaucht, aber auf einer anderen nicht, verschenken Sie Potenzial.

Fragmentierung nach Kategorie

Je wettbewerbsintensiver die Kategorie und je weniger dominant ein einzelner Anbieter, desto stärker weichen die KI-Engines in ihren Empfehlungen voneinander ab. Kategorien mit einem klaren Marktführer (wie CRM mit HubSpot und Salesforce) zeigten weniger Fragmentierung als Kategorien, in denen mehrere Tools auf Augenhöhe konkurrieren.

Fünf Takeaways für Ihre GEO-Strategie

Diese Daten legen konkrete Maßnahmen nahe für alle, die an AI Brand Visibility arbeiten:

1. Tracken Sie pro Provider, nicht aggregiert. Ein Brand-Visibility-Score als Durchschnitt über alle KI-Engines ist irreführend. Sie müssen Ihre Presence Rate bei jedem Provider einzeln kennen. Eine Marke, die im Schnitt bei 50 % liegt, könnte auf einem Provider bei 80 % und auf einem anderen bei 20 % stehen.

2. Identifizieren Sie Ihre schwachen Provider. Wenn Sie auf einer bestimmten KI-Engine unsichtbar sind, ist das ein spezifisches Problem mit einer spezifischen Ursache, die wahrscheinlich damit zusammenhängt, wie dieser Provider Quellmaterial abruft und gewichtet. Die Lösung erfordert Provider-spezifische Taktiken, kein generisches "AI SEO."

3. Priorisieren Sie Wechsel- und Vergleichs-Prompts. Das sind die Queries mit dem höchsten Intent und gleichzeitig die am stärksten fragmentierten. Wenn Sie diese Prompts über alle Provider hinweg gewinnen, erfassen Sie den wertvollsten KI-Traffic.

4. Mid-Market Brands haben am meisten zu gewinnen. Category Leader tauchen tendenziell überall auf. Wenn Sie eine Marke in der Größenordnung von ConvertKit oder Klaviyo sind, ist das Upside durch Provider-spezifische Optimierung enorm. Sie könnten Ihre Presence auf den schwächsten Providern verdoppeln oder verdreifachen.

5. Überprüfen Sie Ihre Annahmen regelmäßig. KI-Modelle werden aktualisiert. Retrieval-Pipelines ändern sich. Was heute gilt, kann sich in 90 Tagen verschoben haben. Das ist kein Set-and-Forget-Kanal.

Der erste Schritt zur Lösung eines Fragmentierungsproblems ist die Messung. Man kann nicht optimieren, was man nicht sieht, und man erkennt Provider-spezifische Unterschiede nur mit Per-Provider-Tracking.

Methodik

Wir haben 4 LLM-Provider (OpenAI GPT-4.1-mini, Anthropic Claude Haiku, Google Gemini Flash Lite, Perplexity Sonar) über 16 Marken in 4 SaaS-Kategorien abgefragt. Jede Marke wurde mit 12 Prompt-Templates x 20 Samples pro Provider getestet, was 3.837 validierte API-Calls ergab. Alle Provider wurden mit aktivierter Websuche abgefragt.

Statistische Rigorosität wurde durchgehend sichergestellt:

- Konfidenzintervalle: Wilson-Score-Intervalle bei 95 % Konfidenz, gewählt wegen ihrer überlegenen Performance bei Anteilsdaten nahe 0 oder 1.

- Paarweise Vergleiche: Newcombe-Intervalle für die Differenz zwischen zwei Proportionen, um zu bestimmen, ob Provider-Unterschiede statistisch aussagekräftig sind.

- Effektstärken: Cohens h zur Quantifizierung der praktischen Größe von Unterschieden über einfache statistische Signifikanz hinaus.

- Sample-Validität: Alle Zellen erreichten den Status "robust" (n>=100), was bedeutet, dass die Fehlermargen eng genug für zuverlässige Rückschlüsse sind.

Popsight trackt die Sichtbarkeit Ihrer Marke bei ChatGPT, Claude, Gemini und Perplexity mit Per-Provider-Breakdowns und statistischen Konfidenzintervallen. Sehen Sie, wo Sie stehen.

Popsight kostenlos testenDaten erhoben Q1 2026.