Eine Frage, viele Antworten

Bitten Sie ChatGPT, ein CRM für Ihr Unternehmen zu empfehlen. Notieren Sie die Antwort. Stellen Sie dieselbe Frage erneut. Gleicher Wortlaut, gleicher Prompt, alles identisch.

Sie bekommen eine andere Liste.

Das ist kein Fehler. So funktioniert KI. Und wenn Sie verstehen wollen, was KI über Ihre Marke sagt, ist das die wichtigste Erkenntnis, die Sie verstehen müssen.

Eine SparkToro-Studie aus 2026 hat dazu harte Zahlen geliefert. 600 Freiwillige gaben dieselben Prompts bei ChatGPT, Claude und Google AI insgesamt 2.961 Mal ein. Das Ergebnis: Die Wahrscheinlichkeit, dass ChatGPT bei zwei beliebigen Durchläufen dieselbe Markenliste liefert, lag unter 1 zu 100. Für dieselbe Liste in derselben Reihenfolge lag sie eher bei 1 zu 1.000.

Das ist kein Messfehler. Das ist das Medium selbst. KI-Antworten sind von Natur aus variabel, und wer behauptet, AI Brand Visibility mit einer Handvoll Abfragen messen zu können, misst Rauschen.

Das ist kein technisches Problem. Es ist ein mathematisches.

Vielleicht denken Sie: Es muss doch eine Einstellung geben, eine Konfiguration, irgendeinen Weg, KI zu konsistenten Antworten zu bewegen?

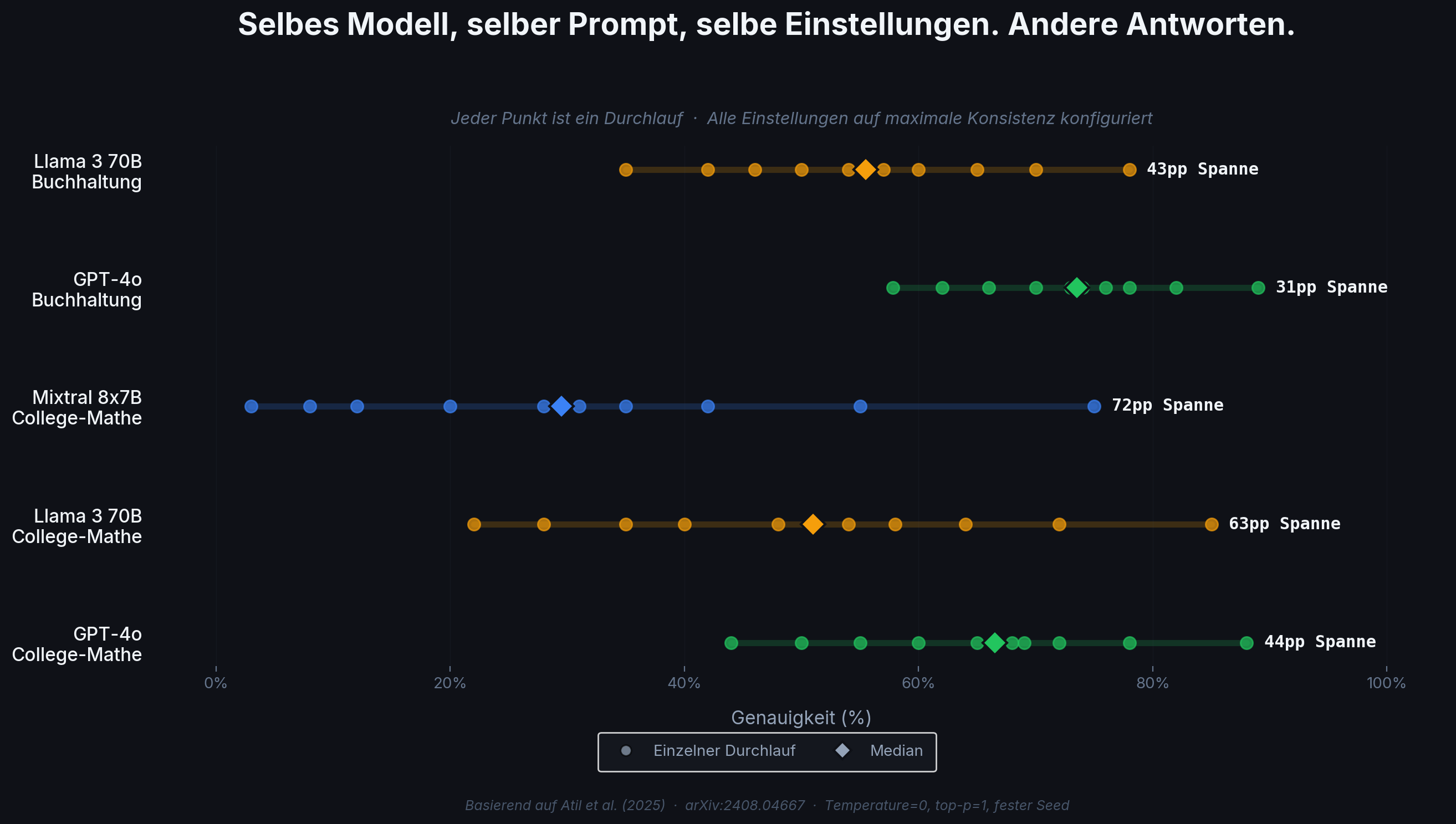

Gibt es nicht. Forscher der Penn State University haben das 2025 direkt getestet. Sie nahmen fünf große KI-Modelle, konfigurierten alles für maximale Konsistenz und wiederholten exakt dieselben Eingaben 10 Mal pro Modell.

Die Ergebnisse:

Ein Modell schwankte über diese 10 Durchläufe zwischen 88% und 44% Genauigkeit. Ein anderes zwischen 75% und 3%. Identische Eingaben, identische Konfiguration, völlig unterschiedliche Ergebnisse.

Die Ursache ist grundlegend: KI-Systeme verarbeiten Ihre Anfrage parallel mit Tausenden anderer Anfragen auf gemeinsamer Hardware. Die exakte Reihenfolge der Berechnungen variiert von Durchlauf zu Durchlauf. Die KI-Anbieter selbst bestätigen das. In Anthropics API-Dokumentation heißt es ausdrücklich, die Ergebnisse seien "not fully deterministic".

Das wird sich nicht ändern. Die Penn-State-Forscher sprachen mit Brancheninsidern, die bestätigten, dass die Variabilität "perhaps essential to the efficient use of compute resources" sei. Sie zu beseitigen würde langsamere und teurere KI für alle bedeuten.

Die Frage ist also nicht "Wie bringen wir KI dazu, konsistente Antworten zu geben?" Die Frage ist: Wie gewinnen wir verlässliche Erkenntnisse aus von Natur aus inkonsistenten Daten?

Diese Frage ist längst beantwortet. Meinungsforscher, Mediziner und Qualitätsingenieure haben sie vor Jahrzehnten gelöst. Die Antwort: Stichproben und Konfidenzintervalle.

Die Wahlumfrage-Analogie

Stellen Sie sich vor, Sie wollen wissen, welchen Kandidaten die Wähler bevorzugen. Sie würden nicht eine einzige Person fragen und das als Ergebnis nehmen. Sie würden auch nicht fünf Leute fragen. Sie würden Hunderte befragen und dann mit Statistik die wahre Präferenz schätzen, inklusive Fehlermarge.

AI Brand Visibility funktioniert genauso.

Fragen Sie ChatGPT einmal nach Ihrer Produktkategorie, und Sie erhalten einen einzelnen Zufallswert. Fragen Sie 20 Mal und zählen Sie, wie oft Ihre Marke vorkommt. Dieser Prozentsatz ist Ihre Visibility Rate, und die Unsicherheitsspanne darum herum ist Ihr Konfidenzintervall.

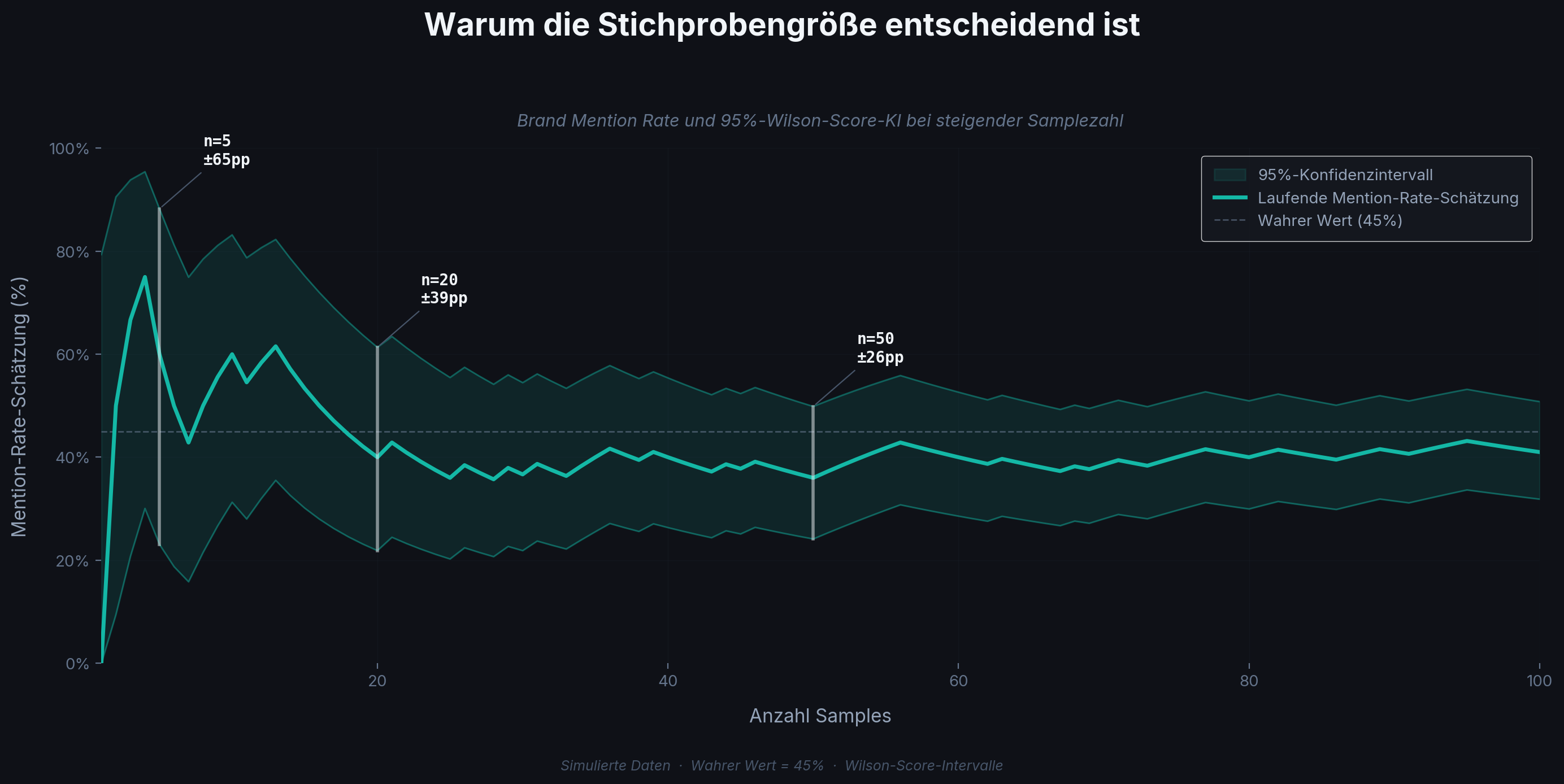

Mit 5 Samples streut die Schätzung enorm: Ihre Marke taucht vielleicht in 80% oder in 20% der Fälle auf, und Sie können nicht sagen, was näher an der Realität liegt. Bei 20 Samples pendelt sich die Schätzung ein und das Konfidenzintervall wird eng genug, um nützlich zu sein. Bei 50 haben Sie eine enge, verlässliche Messung.

Das Konfidenzintervall ist der ehrliche Teil. Es sagt: "Basierend auf unseren Beobachtungen liegt der wahre Wert höchstwahrscheinlich zwischen X und Y." Ein breites Intervall bedeutet: mehr Daten nötig. Ein enges: Sie können der Zahl vertrauen.

Wann ist ein Unterschied real?

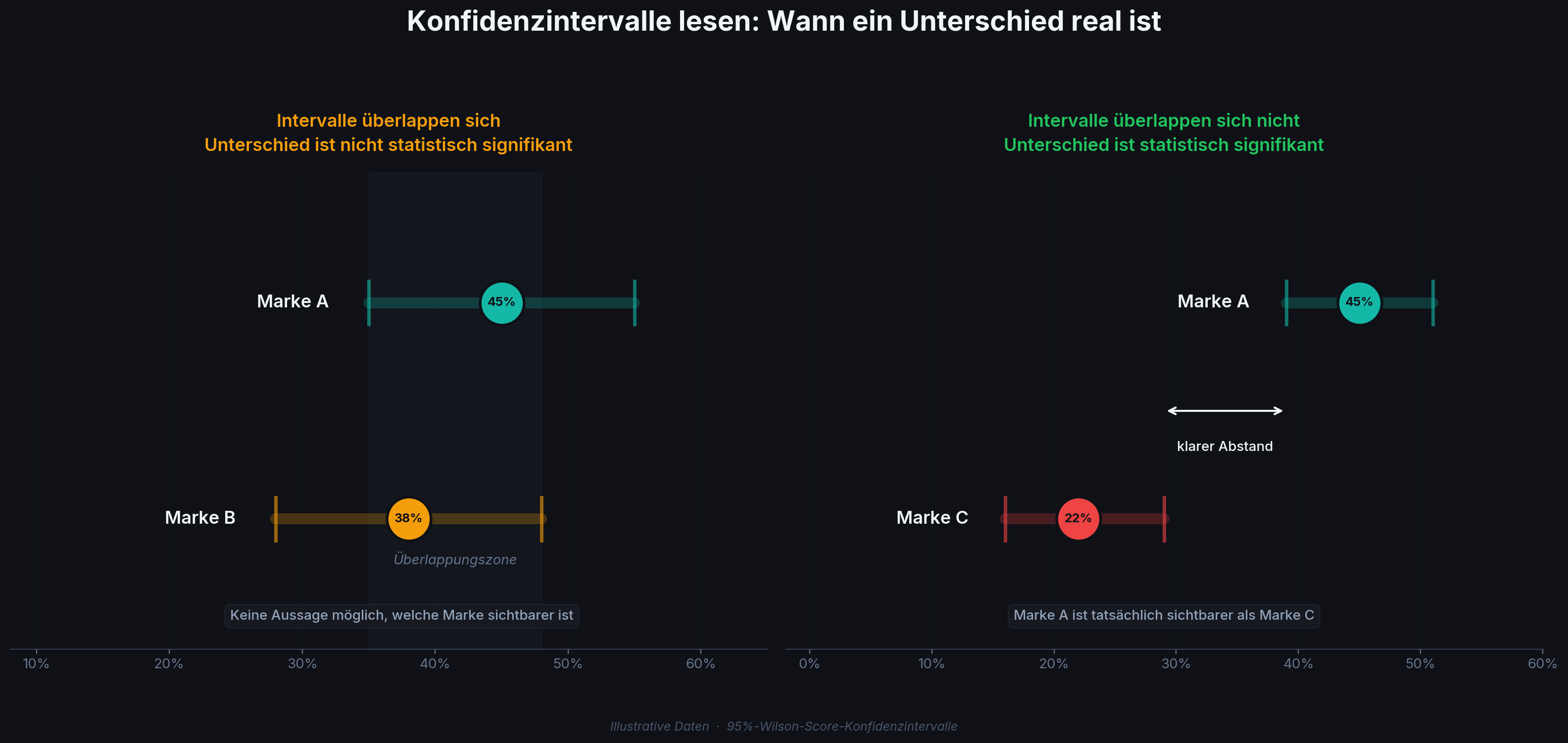

Hier zeigen Konfidenzintervalle ihren wahren Wert. Angenommen, Sie vergleichen, wie oft KI Ihre Marke versus einen Wettbewerber erwähnt.

Szenario 1: Sie messen Ihre Marke bei 45% und einen Wettbewerber bei 38%. Sieht nach Vorsprung aus. Aber die Konfidenzintervalle überlappen sich:

- Ihre Marke: 45%, Intervall [35%, 55%]

- Wettbewerber: 38%, Intervall [28%, 48%]

Die wahren Werte könnten leicht identisch sein. Mit diesen Daten lassen sich die beiden nicht unterscheiden. Hier den Sieg zu erklären wäre voreilig.

Szenario 2: Sie messen Ihre Marke bei 45% und einen anderen Wettbewerber bei 22%. Die Intervalle überlappen sich nicht:

- Ihre Marke: 45%, Intervall [39%, 51%]

- Wettbewerber: 22%, Intervall [16%, 29%]

Jetzt ist der Abstand real. Ihre Marke ist tatsächlich sichtbarer, und Sie können auf dieser Basis Entscheidungen treffen.

Ohne Konfidenzintervalle sehen beide Szenarien aus wie "wir liegen vorn." Mit ihnen sehen Sie, dass nur einer der beiden Vorsprünge aussagekräftig ist. Dieser Unterschied ist der Unterschied zwischen Daten und Raten.

Wie viele Samples brauchen Sie?

Weniger als Sie vielleicht denken.

Popsight verwendet Wilson-Score-Konfidenzintervalle, eine statistische Methode, die genau für Häufigkeitsdaten entwickelt wurde: Sie misst, wie oft etwas passiert (etwa wie oft eine Marke in einer KI-Antwort auftaucht). Anders als einfachere Methoden funktionieren Wilson-Score-Intervalle auch bei kleinen Stichproben und liefern auch in Grenzfällen (eine Marke taucht in 0% oder 100% der Fälle auf) sinnvolle Ergebnisse.

Für die meisten Brand-Visibility-Fragen reichen 20 Samples pro Abfrage pro Anbieter, um aussagekräftige Trends zu erkennen. Die Intervalle werden breiter sein als bei 50 oder 100 Samples, aber sie werden ehrlich über diese Unsicherheit sein.

Ein weiteres wichtiges Detail: Die Penn-State-Forscher testeten, ob KI-Outputs einer Glockenkurve folgen (der Normalverteilung, die die meisten einfachen Statistik-Methoden voraussetzen). Tun sie nicht. Die Schwankungen sind ungleichmäßig und unvorhersehbar. Das bedeutet: Einfachere statistische Methoden, die eine Glockenkurve annehmen, liefern irreführende Ergebnisse. Wilson-Score-Intervalle machen diese Annahme nicht, und das ist einer der Gründe, warum wir sie verwenden.

Vier Ebenen der Variation

Wenn Sie AI Brand Visibility messen, stapeln sich vier unabhängige Variationsquellen übereinander:

1. Antwortvariabilität. Dasselbe KI-Modell liefert bei demselben Prompt jedes Mal andere Antworten. Das ist es, was die Penn-State-Studie dokumentiert hat. Es steckt in der Infrastruktur.

2. Formulierungssensitivität. "Was ist das beste CRM?" und "Welches CRM empfehlen Sie für ein kleines Unternehmen?" erzeugen unterschiedliche Markenlisten, selbst beim selben Modell in derselben Minute.

3. Anbieter-Divergenz. ChatGPT, Claude, Gemini und Perplexity haben jeweils eigene Trainingsdaten und eigene Verzerrungen. In unserer eigenen Studie mit 3.837 KI-Abfragen über 16 Marken stimmten die vier großen Anbieter nur in etwa einem Drittel der Fälle bei ihrer Top-Empfehlung überein.

4. Nutzer-Personalisierung. Consumer-KI-Produkte wie ChatGPT merken sich Ihre Präferenzen. Wenn Sie ChatGPT gesagt haben, dass Sie Notion bevorzugen, wird es Notion in zukünftigen Empfehlungen stärker gewichten. Das ist vergleichbar damit, wie Google seit über einem Jahrzehnt Suchergebnisse personalisiert: Dieselbe Suche liefert verschiedenen Nutzern verschiedene Ergebnisse, basierend auf ihrer Historie.

Popsight misst die Ebenen 1 bis 3, indem es KI-Anbieter direkt über ihre APIs abfragt. API-Verbindungen sind zustandslos: Jede Abfrage startet ohne Nutzerhistorie, ohne Memory und ohne Personalisierung. Das liefert die Baseline Visibility Ihrer Marke: die Empfehlung, die ein neuer Nutzer ohne Präferenzen sehen würde. Es ist die Ebene, die Sie über die Zeit tracken, mit Wettbewerbern vergleichen und durch Ihren Content und Ihre Positionierung tatsächlich beeinflussen können.

Ebene 4, die Nutzer-Personalisierung, sitzt auf dieser Baseline. Sie variiert von Person zu Person und lässt sich von keinem Tool umfassend messen. Aber die Baseline ist wichtig, aus demselben Grund, aus dem SEO-Profis weiterhin "saubere" Rankings tracken, obwohl jeder Google-Nutzer personalisierte Ergebnisse sieht: Die Baseline ist die kontrollierbare, vergleichbare Grundlage, von der die Personalisierung abweicht.

Jeder seriöse Ansatz für Generative Engine Optimization muss all das berücksichtigen. Das bedeutet: Mehrere Samples pro Abfrage, verschiedene Formulierungen, mehrere Anbieter, Konfidenzintervalle auf jeder Zahl, und ein ehrliches Verständnis davon, was die Zahlen repräsentieren.

Was das in der Praxis bedeutet

Wenn Sie AI Brand Visibility messen oder darüber nachdenken, dann sollten Sie Folgendes beachten:

Einzelabfragen sind keine Daten. Jeder Workflow, bei dem Sie eine KI einmal etwas fragen und die Antwort als AI Presence Ihrer Marke notieren, produziert Rauschen. Das gilt für manuelle Stichproben, einmalige Wettbewerber-Screenshots und Live-Demos, bei denen jemand auf der Bühne einen Prompt eintippt.

Prozentwerte ohne Spannweiten sind unvollständig. Wenn ein Tool oder ein Bericht Ihnen zeigt "Ihre Marke wird in 40% der Fälle erwähnt", ohne Konfidenzintervall, fehlt der wichtigste Teil: wie sehr Sie dieser Zahl vertrauen können. Ein Rückgang von 40% auf 35% könnte normale Schwankung sein. Oder ein echter Rückgang. Das Intervall sagt Ihnen, was von beidem zutrifft.

Messung über mehrere Anbieter hinweg ist entscheidend. Eine Marke kann bei ChatGPT die Top-Empfehlung und bei Gemini komplett abwesend sein. Einen Anbieter zu prüfen sagt etwas über diesen Anbieter aus, nicht über die AI Visibility Ihrer Marke insgesamt.

Variation ist normal. Das Ziel der Messung ist nicht, Variation zu eliminieren. Es ist, genug Daten zu sammeln, um durch sie hindurchzusehen, und transparent darüber zu sein, was man weiß und was nicht.

Popsight berechnet 95%-Wilson-Score-Konfidenzintervalle für jede Metrik, über jeden Anbieter hinweg. Kostenlos herunterladen und Ihre erste Analyse in Minuten starten. 14 Tage Testversion, alle Features, keine Kreditkarte.